원문: Announcing General Availability of Databricks’ Delta Live Tables (DLT) (2022-04-05)작성자: Michael Armbrust, Awez Syed, Paul Lappas, Erika Ehrli, Sam Steiny, Richard Tomlinson, Andreas Neumann, Mukul Murthy

고객들이 레이크하우스에서 간편한 스트리밍 및 배치 ETL로 성공하다

오늘, Delta Live Tables(DLT)가 Amazon AWS 및 Microsoft Azure 클라우드에서 정식 출시(GA)되고, Google Cloud에서 공개 프리뷰로 제공됨을 알리게 되어 매우 기쁩니다! 이 블로그 포스트에서는 DLT가 선도 기업의 데이터 엔지니어와 분석가들이 프로덕션에 즉시 투입 가능한 스트리밍 또는 배치 파이프라인을 쉽게 구축하고, 대규모 인프라를 자동으로 관리하며, 차세대 데이터, 분석 및 AI 애플리케이션을 제공하는 데 어떻게 도움을 주고 있는지 살펴봅니다. ETL을 위한 스트리밍 및 배치 워크로드 처리는 분석, 데이터 사이언스, ML 워크로드의 근본적인 과제입니다 — 이는 조직이 생성하는 방대한 양의 데이터를 고려할 때 계속 가속화되고 있는 추세입니다. 하지만 이 원시의 비정형 데이터를 깨끗하고, 문서화되고, 신뢰할 수 있는 정보로 가공하는 것은 비즈니스 인사이트를 도출하기 위한 핵심 단계입니다. 우리는 고객들로부터 SQL 쿼리를 프로덕션 ETL 파이프라인으로 전환하는 데 일반적으로 많은 지루하고 복잡한 운영 작업이 수반된다는 것을 배웠습니다. 작은 규모에서조차 데이터 엔지니어의 시간 대부분은 변환 작업이 아니라 도구 관리와 인프라 운영에 소비됩니다. 또한 고객들로부터 관측성(observability)과 거버넌스가 구현하기 매우 어려워 결과적으로 솔루션에서 완전히 빠지는 경우가 많다는 것을 알게 되었습니다. 이로 인해 차별화되지 않는 작업에 많은 시간을 소비하게 되었고, 데이터는 신뢰할 수 없고, 안정적이지 않으며, 비용이 많이 드는 상태가 되었습니다. 이것이 바로 우리가 Delta Live Tables를 만든 이유입니다. DLT는 간단한 선언적 접근 방식을 사용하여 신뢰할 수 있는 데이터 파이프라인을 구축하고 대규모 인프라를 자동으로 관리하는 최초의 ETL 프레임워크입니다. 이를 통해 데이터 분석가와 엔지니어는 도구 관리에 드는 시간을 줄이고 데이터에서 가치를 얻는 데 집중할 수 있습니다. DLT는 데이터 엔지니어와 분석가가 개발을 가속화하고 복잡한 운영 작업을 자동화하여 구현 시간을 획기적으로 단축할 수 있게 해줍니다. Delta Live Tables는 이미 전 세계 선도 기업에서 프로덕션 사용 사례를 구동하고 있습니다. 스타트업부터 대기업까지, ADP, Shell, H&R Block, Jumbo, Bread Finance, JLL 등 400개 이상의 기업이 DLT를 사용하여 차세대 셀프서비스 분석 및 데이터 애플리케이션을 구축하고 있습니다:“ADP에서는 인사 관리 데이터를 레이크하우스의 통합 데이터 저장소로 마이그레이션하고 있습니다. Delta Live Tables는 우리 팀이 품질 제어를 내장하는 데 도움을 주었고, 선언적 API와 SQL만으로 배치 및 실시간을 지원하기 때문에 팀이 데이터 관리에 드는 시간과 노력을 절약할 수 있게 해주었습니다.” — Jack Berkowitz, ADP 최고 데이터 책임자(CDO)

“우리의 목표는 머신 러닝을 지속적으로 활용하여 새로운 시장과 지역으로 진출할 수 있는 혁신적인 제품을 개발하는 것입니다. Databricks는 이 전략의 기초 부분으로, 더 빠르고 효율적으로 목표에 도달하는 데 도움을 줄 것입니다. Delta Live Tables는 우리가 이전에는 할 수 없었던 규모와 성능 측면의 작업을 가능하게 해주었습니다 — 출시 시간이 86% 단축되었습니다. 이제 우리는 이전의 주간 또는 월간 실행 대신 파이프라인을 일 단위로 실행합니다 — 이는 규모 면에서 엄청난 개선입니다.” — Joel Lowery, Audantic 최고 정보 책임자(CIO)

“Shell에서는 모든 센서 데이터를 통합 데이터 저장소로 집계하고 있습니다. Delta Live Tables는 우리 팀이 [수조 건 규모의] 데이터를 관리하고 AI 엔지니어링 역량을 지속적으로 향상시키는 데 드는 시간과 노력을 절약해 주었습니다. 기존 레이크하우스 아키텍처를 보완하는 이 기능을 통해 Databricks는 ETL 및 데이터 웨어하우스 시장을 혁신하고 있으며, 이는 우리와 같은 기업에게 중요한 일입니다. 우리는 혁신 파트너로서 Databricks와 계속 협력해 나가는 것을 기대합니다.” — Dan Jeavons, Shell 데이터 사이언스 총괄

“Delta Live Tables는 협업을 가능하게 하고 데이터 엔지니어링 리소스 병목을 제거하여, 분석 및 BI 팀이 Spark나 Scala를 알 필요 없이 셀프서비스할 수 있게 해줍니다. 실제로 우리 데이터 분석가 중 한 명은 — Databricks나 Spark 경험이 전혀 없었음에도 — 대부분 SQL만 사용하여 S3의 파일 스트림을 활용 가능한 탐색용 데이터셋으로 변환하는 DLT 파이프라인을 수 시간 만에 구축할 수 있었습니다.” — Christina Taylor, Bread Finance 시니어 데이터 엔지니어

ETL 처리를 위한 현대적 소프트웨어 엔지니어링

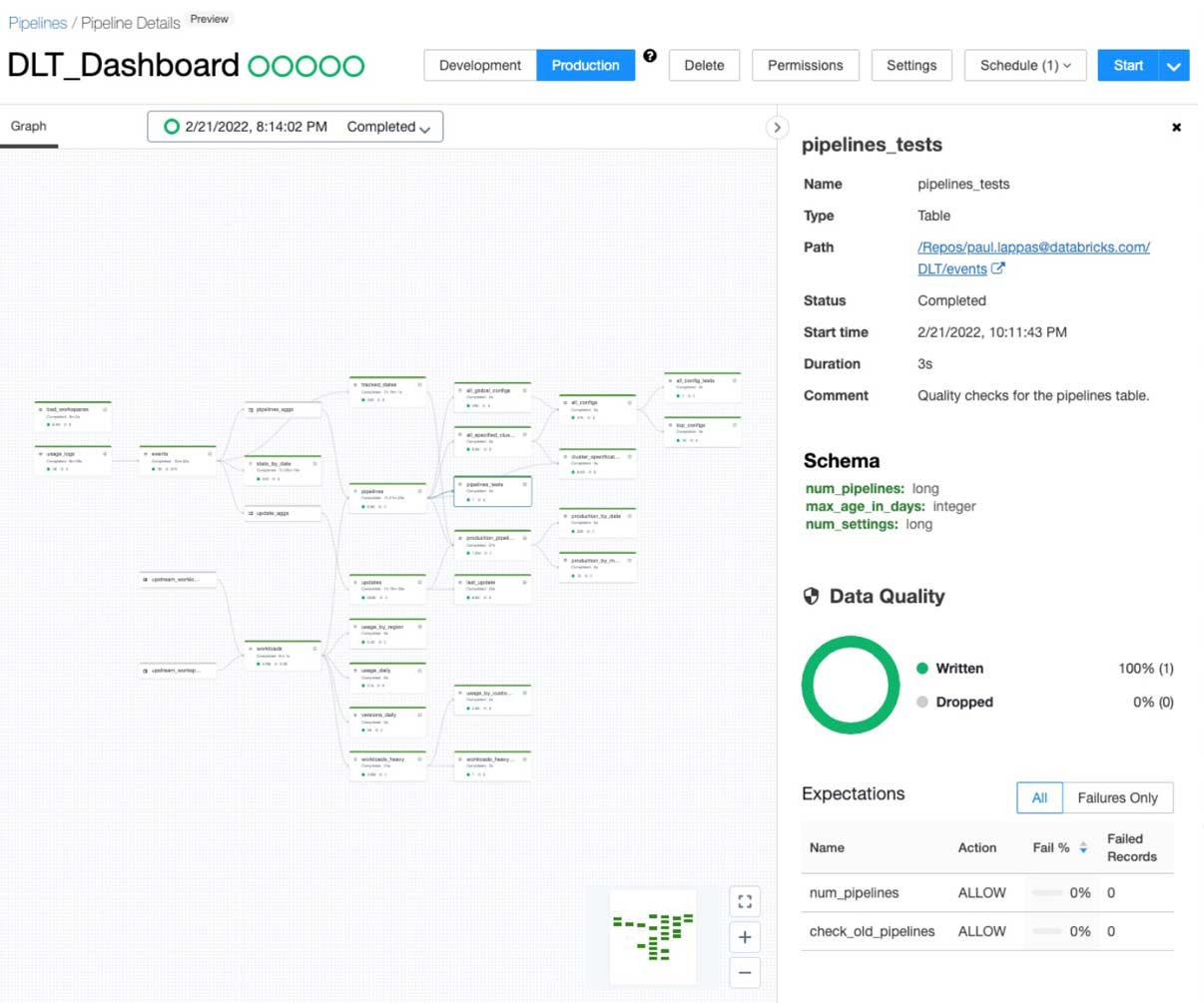

DLT는 분석가와 데이터 엔지니어가 SQL과 Python으로 프로덕션에 즉시 투입 가능한 스트리밍 또는 배치 ETL 파이프라인을 쉽게 구축할 수 있게 해줍니다. DLT는 전체 데이터 파이프라인에 대한 선언적 설명을 캡처하여 의존성을 실시간으로 이해하고, 내재된 거의 모든 운영 복잡성을 자동으로 제거함으로써 ETL 개발을 단순화합니다. DLT를 사용하면 엔지니어는 파이프라인을 운영하고 유지보수하는 대신 데이터를 전달하는 데 집중하고, 다음과 같은 핵심 이점을 활용할 수 있습니다: ETL 개발 가속화: 엔드투엔드 파이프라인을 구축하기 위해 코드 조각을 수동으로 조립해야 하는 다른 솔루션과 달리, DLT는 SQL과 Python으로 전체 데이터 플로우를 선언적으로 표현할 수 있게 해줍니다. 또한 DLT는 프로덕션과 분리된 환경에서 개발하는 기능, 배포 전 쉽게 테스트하는 기능, 파라미터화를 사용하여 환경을 배포하고 관리하는 기능, 단위 테스트 및 문서화 등 현대적 소프트웨어 엔지니어링 모범 사례를 네이티브로 지원합니다. 결과적으로, 변환 표현, CI/CD, SLA 및 품질 기대값을 위한 일급(first-class) 구조와 배치 및 스트리밍을 단일 API에서 원활하게 처리하는 기능을 통해 ETL 파이프라인의 개발, 테스트, 배포, 운영 및 모니터링을 단순화할 수 있습니다. 인프라 자동 관리: DLT는 인프라를 자동으로 관리하고 복잡하고 시간이 많이 소요되는 활동을 자동화하기 위해 처음부터 설계되었습니다. 변화하고 예측 불가능한 데이터 볼륨에 대해 최적의 성능을 위한 클러스터 크기를 결정하는 것은 어렵고 과잉 프로비저닝으로 이어질 수 있습니다. DLT는 사용자에게 최소 및 최대 인스턴스 수를 설정하는 옵션을 제공하고 클러스터 활용도에 따라 클러스터 크기를 자동으로 조정하여 성능 SLA를 충족하도록 컴퓨팅을 자동으로 확장합니다. 또한 오케스트레이션, 오류 처리 및 복구, 성능 최적화 등의 작업이 모두 자동으로 처리됩니다. DLT를 사용하면 운영 대신 데이터 변환에 집중할 수 있습니다. 데이터 신뢰성: 정확하고 유용한 BI, 데이터 사이언스 및 ML을 보장하기 위해 내장된 품질 제어, 테스트, 모니터링 및 적용을 통해 신뢰할 수 있는 데이터를 제공합니다. DLT는 기대값(Expectations)이라는 기능을 사용하여 데이터 품질 관리 및 모니터링 도구에 대한 일급 지원을 포함함으로써 신뢰할 수 있는 데이터 소스를 쉽게 만들 수 있게 해줍니다. 기대값은 불량 데이터가 테이블로 유입되는 것을 방지하고, 시간에 따른 데이터 품질을 추적하며, 세밀한 파이프라인 관측성으로 불량 데이터를 문제 해결할 수 있는 도구를 제공하여 파이프라인의 고충실도 리니지 다이어그램을 얻고, 의존성을 추적하며, 모든 파이프라인에 걸쳐 데이터 품질 메트릭을 집계할 수 있게 합니다. 배치와 스트리밍의 단순화: 배치 또는 스트리밍 처리를 위한 자체 최적화 및 자동 확장 데이터 파이프라인으로 애플리케이션에 가장 신선하고 최신의 데이터를 제공하며, 최적의 비용 대비 성능을 선택할 수 있습니다. 스트리밍과 배치 워크로드를 별도로 처리하도록 강제하는 다른 제품과 달리, DLT는 단일 API로 모든 유형의 데이터 워크로드를 지원하므로 데이터 엔지니어와 분석가 모두 고급 데이터 엔지니어링 기술 없이도 클라우드 규모의 데이터 파이프라인을 더 빠르게 구축할 수 있습니다. DLT의 프리뷰 출시 이후, 우리는 여러 엔터프라이즈 기능과 UX 개선 사항을 도입했습니다. DLT 파이프라인을 더 쉽게 예약하고, 오류를 확인하고, ACL을 관리할 수 있도록 UI를 확장했으며, 테이블 리니지 시각화를 개선하고, 데이터 품질 관측성 UI와 메트릭을 추가했습니다. 또한 지속적으로 도착하는 데이터를 효율적이고 쉽게 캡처하기 위한 변경 데이터 캡처(CDC) 지원을 출시했으며, 스트리밍 워크로드에 우수한 성능을 제공하는 향상된 자동 확장(Enhanced Auto Scaling) 프리뷰를 발표했습니다.

DLT의 프리뷰 출시 이후, 우리는 여러 엔터프라이즈 기능과 UX 개선 사항을 도입했습니다. DLT 파이프라인을 더 쉽게 예약하고, 오류를 확인하고, ACL을 관리할 수 있도록 UI를 확장했으며, 테이블 리니지 시각화를 개선하고, 데이터 품질 관측성 UI와 메트릭을 추가했습니다. 또한 지속적으로 도착하는 데이터를 효율적이고 쉽게 캡처하기 위한 변경 데이터 캡처(CDC) 지원을 출시했으며, 스트리밍 워크로드에 우수한 성능을 제공하는 향상된 자동 확장(Enhanced Auto Scaling) 프리뷰를 발표했습니다.